Los posibles “beneficios” de las tecnologías de reconocimiento facial son mínimos en comparación con sus riesgos.

POR CAROLINA MARTÍNEZ ELEBI (*)

@titayna

Mientras en ciudades como San Francisco se prohibió la adquisición y el uso de tecnologías de reconocimiento facial, el gobierno de la Ciudad de Buenos Aires lo presentó en abril de 2019 como un gran avance en la lucha contra la delincuencia y la ciudad de Córdoba anunció su implementación en octubre. ¿Por qué es necesario dejar de pensar en cómo regular estos sistemas y hay que prohibirlos definitivamente?

Me acuerdo cuando en 2011 se lanzó en Warner la serie Person of interest. En la intro, uno de los protagonistas nos contaba lo siguiente: “Estás siendo observado. El gobierno tiene un sistema secreto. Una máquina que te espía a cada hora todos los días. Lo sé porque yo la construí. Diseñé la máquina para detectar actos terroristas, pero lo ve todo. Crímenes violentos que involucran a gente normal. Gente como tú. Crímenes que el gobierno considera irrelevantes”1. Cuando la vi por primera vez, me acuerdo que sentí una mezcla de incomodidad y de indignación, pero que automáticamente desapareció porque sabía que era una ficción. En el fondo, sabía que era algo que en algún momento iba a poder desarrollarse y que, cuando llegara ese momento, la sociedad tendría que manifestarse en contra de ese sistema que nos iba a vigilar a todas las personas, violando nuestra privacidad junto con muchos otros derechos. Pensaba que faltaba mucho tiempo para que eso pasara. Sin embargo, fue más rápido de lo que imaginaba.

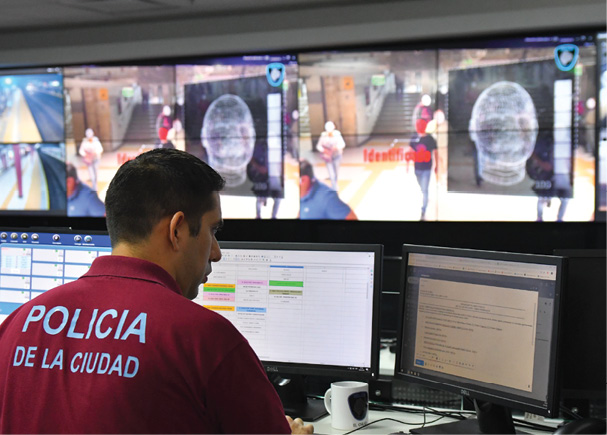

Como explicó Emiliano Falcón en el número 23 de Revista Fibra, siguiendo a la Electronic Frontier Foundation: “Los sistemas de reconocimiento facial usan sistemas basados en complejos algoritmos para detectar estos detalles específicos y distintivos de las caras de las personas a partir de una foto, una serie de fotos, o un segmento de video. Estos detalles, que pueden ser la distancia entre los ojos, la forma de la pera, o la traza de líneas imaginarias sobre la cara, son luego convertidos en una representación matemática y comparados con información de otras caras previamente recolectados y guardados en una base de datos. Toda esta información se utiliza para crear ‘plantillas de caras’, que solo incluyen esos detalles. Así, a cada persona le corresponde una. Ya con el sistema en funcionamiento, estas plantillas son utilizadas para reconocer e identificar a dichas personas en nuevas fotos o vídeos”2. De esto se trata el Sistema de Reconocimiento Facial de Prófugos que instaló el gobierno de la Ciudad Autónoma de Buenos Aires (CABA) en abril de este año y que fue cuestionado desde su anuncio. En octubre, Córdoba presentó su propio sistema3.

En ciudades donde ya se implementan cámaras con reconocimiento facial, las personas están en el foco policial de manera perpetua. Estos sistemas, que son presentados por los gobiernos como herramientas útiles para “combatir el delito”, terminan siendo utilizados para vigilar, espiar y perseguir a personas que resultan una molestia para los gobiernos de turno, aunque no hayan cometido ningún crimen. Como dice Shoshana Zuboff, autora del libro Capitalismo de vigilancia: “Todo sistema que pueda ser usado para la vigilancia será usado para la vigilancia”.

Se pierde más que lo que se gana

Hace poco, un conocido me dijo algo que yo había leído alguna vez pero que nunca le había escuchado a alguien decirlo en serio: “Si yo no oculto nada, ¿qué me importa que me estén vigilando todo el tiempo?”. Esta idea está instalada en el sentido común y me interesa traerla a la conversación para ponerla en cuestión. Sobre todo en países latinoamericanos, que tenemos una historia muy reciente de persecución, torturas, desapariciones y asesinatos, no podemos ignorar el poder de un Estado que tiene centralizada tanta información sobre sus ciudadanos y ciudadanas.

En principio, quien piense así tiene que tener en cuenta que lo que ayer fue delito, hoy no lo es, y mañana puede volver a serlo. Por otro lado, es importante recordar que el espacio privado no es sólo aquel que está reservado a la intimidad de nuestras casas sino que es algo que uno transporta consigo permanentemente. Por lo que, a pesar de estar circulando por la vía pública existe lo que se conoce como la “expectativa de privacidad”. Es decir que lo que hacemos en la vía pública esperamos que sea visto sólo por aquellas personas que están presentes en ese momento y en ese lugar junto a nosotros.

Ahora, la pérdida de privacidad tiene un impacto directo en la vulneración de otros derechos. ¿Qué pierden las personas a partir del uso de sistemas de reconocimiento facial en la vía pública? Las protecciones del debido proceso, el derecho a la libre circulación, el derecho a la libre asociación y el derecho a la libertad de expresión sin temor a ser rastreadas.

A diferencia de países como Estados Unidos, donde para tener una credencial que las identifique, las personas deben tener un número de seguro social o una licencia de conducir, en Argentina tenemos el Documento Nacional de Identidad obligatorio desde que nacemos. Esto es así desde 1968, cuando el dictador Juan Carlos Onganía sancionó la ley 17.671 de Identificación, Registro y Clasificación del Potencial Humano Nacional4, vigente actualmente. A partir de entonces, los DNI quedaron a cargo del Registro Nacional de las Personas (RENAPER). A partir de ello, el Estado argentino tiene una base de datos con los números de DNI asociados a nombres, apellidos, fechas de nacimiento y domicilios de toda la población documentada (es obligatorio desde el nacimiento). Pero, además, desde la creación del Sistema Federal de Identificación Biométrica para la Seguridad (SIBIOS), a partir del Decreto 1766/11, el Estado tiene identificados a todos y a todas por nuestras huellas dactilares y nuestros rostros.

Es así, entonces, como el Sistema de Reconocimiento Facial de Prófugos de la Ciudad puede funcionar. De las más de 9000 cámaras que hay en la CABA, 300 tendrán corriendo el sistema de reconocimiento facial —que irán rotando a lo largo del día— para leer, identificar y detectar si alguna de las cientos de miles de personas que circulan por la ciudad cometió algún delito y está prófuga. Desde el gobierno explican que el sistema utiliza la base de datos de Consulta Nacional de Rebeldías y Capturas (CONARC), de carácter pública y administrada por el Ministerio de Justicia de la Nación, junto con los datos biométricos del RENAPER5. Sobre esto, Enrique Chaparro de Fundación Vía Libre cuestiona que “si efectivamente el proceso de control es respecto de varias decenas de miles de personas que deberían comparecer ante la justicia, ¿por qué razón han tomado las bases de datos del RENAPER y de la Dirección Nacional de Migraciones?”6.

Tecnologías de reconocimiento biométrico en el sector privado

A comienzos de noviembre de este año, la Universidad Austral anunció que a partir de marzo de 2020 implementará un sistema que mide las emociones de los alumnos de la MBA. Actualmente, el sistema se encuentra en fase experimental en un aula. ¿Qué haría este sistema? Capta los gestos de los estudiantes y advierte en el momento cuán atento está cada uno. El sistema —explican— distinguiría entre siete emociones: enojo, desprecio, desagrado, tristeza, sorpresa, felicidad y un estado neutral, que es el que, en general, domina. Para llevar adelante este sistema, explican que será obligatorio firmar un consentimiento previo que autorice la medición.

¿Cuáles son sólo algunos de los muchos problemas que presenta esta iniciativa? Viola Derechos Humanos; “medir emociones” es un eufemismo de control; al no ser una tecnología robusta, puede fallar. Lo que se comprueba con este tipo de iniciativas del sector privado es que cada vez resulta más necesario un marco regulatorio federal y de orden público para el uso de las tecnologías de reconocimiento biométrico. Por último, es indispensable tener en cuenta que, ante una posible modificación en la Ley de protección de datos personales, los datos biométricos —así como los genéticos— deberían ser incluidos en la categoría de datos sensibles para gozar de mayor protección.

¿Y qué sucedió hasta ahora? El Observatorio de Derecho Informático Argentino (ODIA)7 recibió el 6 de noviembre de 2019 la respuesta del Gobierno de la Ciudad de Buenos Aires a un pedido de Acceso a la Información Pública sobre el sistema de reconocimiento facial desde que comenzó a funcionar en abril. A través de Twitter, compartieron la información que les fue proporcionada8 y, según resumieron, desde el 24 de abril al 15 de agosto, el sistema había disparado 3059 alertas de coincidencias9. Sin embargo, hasta el 25 de julio, según averiguaron desde ODIA, se habrían puesto a disposición de la justicia sólo 1337 personas (el 43,7%) y, de ese número, más del 80% fue liberado inmediatamente por la justicia. La primera conclusión a la que llegan desde el Observatorio es evidente: el sistema arroja más del 50% de errores. Por su parte, según TN10, el sistema activó 1227 alertas, de las cuales sólo 226 personas fueron detenidas por delitos graves (18,41%), mientras que las 1001 restantes fueron liberadas inmediatamente (81,59%). La tasa de error es enorme. ¿Qué significan estos errores? Personas a las que les vulneraron sus derechos. El caso más extremo que se conoció hasta el momento fue el de Guillermo Ibarrola, quien estuvo detenido seis días por un delito que él no cometió. ¿La explicación? “Errores de carga”11.

Entonces, la conclusión: los beneficios que podrían traer los sistemas de reconocimiento facial (o los que dicen tener quienes las promueven) no se acercan a superar los riesgos de su implementación. El reconocimiento facial es una tecnología única en su tipo. Nuestros rostros son fundamentales para nuestras identidades y son difíciles de ocultar. Además, como explican desde ADC en el informe La identidad que no podemos cambiar, “la biometría no está exenta de ser vulnerable”12.

California, un ejemplo

En Estados Unidos, la tecnología de reconocimiento facial está siendo criticada por republicanos (como Jim Jordan de Ohio) y por los demócratas (como Alexandria Ocasio-Cortez de Nueva York). De hecho, en mayo de 2019, se había conocido la noticia de que San Francisco era la primera ciudad de Estados Unidos en prohibir las tecnologías de reconocimiento facial, y unos meses más tarde, en octubre, el gobernador del estado de California —de donde San Francisco es parte— promulgó la ley que prohibía el uso de cámaras de reconocimiento facial. Algunos de los fundamentos de la ley, son: 1) el valor de la privacidad como elemento esencial de la libertad personal; 2) estas y otras tecnologías de vigilancia biométrica entrañan amenazas únicas y significativas a los derechos y las libertades civiles; 3) existe un elevado riesgo de dañinos “falsos positivos”, principalmente en mujeres, jóvenes y personas de color.

Quienes también se sumaron a la prohibición de su uso en las agencias gubernamentales —incluida la policía— son Oakland, Berkeley y Sommerville (Massachusetts). Por su parte, el senador Bernie Sanders —candidato demócrata a la presidencia— expresó su preocupación y aseguró que limitar la contratación pública no es suficiente para proteger los derechos civiles y la privacidad, sino que la prohibición debe extenderse también al sector privado. “Don’t regulate facial recognition, ban it” leí en repetidas oportunidades el último año. Es importante tener en cuenta que, además de desarrollos explícitamente maliciosos como el spyware, Estados Unidos ha prohibido muy pocas tecnologías, incluso aquellas utilizadas en la guerra. En el caso del reconocimiento facial, parece que la solución va por ahí.

2 Texto completo de la ley: https://bit.ly/2qytNXy

3 “No regules el reconocimiento facial. Prohibilo” es el título de esta nota de BuzzFeed (https://www.buzzfeednews.com/article/evangreer/dont-regulate-facial-recognition-ban-it ) y fue el título original de esta nota de Selinger y Hartzog, especialistas en el tema, publicada en The New York Times: https://www.nytimes.com/2019/10/17/opinion/facial-recognition-ban.html.

1 Person Of Interest – Intro (subtitulado) https://youtu.be/ilCIIpjFAfM

2 “La tecnología de reconocimiento facial: donde muere la libertad” por Emiliano Falcón, en Revista Fibra N° 23. Disponible en: http://papel.revistafibra.info/la-tecnologia-de-reconocimiento-facial-donde-muere-la-libertad/

3 “Especialistas rechazan la aplicación de tecnología para reconocimiento facial”, publicado el 16 de octubre de 2019 en Cba24n. Disponible en: https://www.cba24n.com.ar/especialistas-rechazan-la-aplicacion-de-tecnologia-para-reconocimiento-facial/

4 Texto completo: http://servicios.infoleg.gob.ar/infolegInternet/anexos/25000-29999/28130/norma.htm

5 “#ConMiCaraNo: Reconocimiento facial en la Ciudad de Buenos Aires” por ADC https://adc.org.ar/2019/05/23/con-mi-cara-no-reconocimiento-facial-en-la-ciudad-de-buenos-aires/

6 “Reconocimiento facial para capturar delincuentes con cámaras: ¿cómo funciona?” entrevista a Enrique Chaparro en La Repregunta (La Nación+). Disponible en: https://bit.ly/2NrYE16

9 Las alertas se refieren a coincidencias entre la base de datos del RENAPER y la base de datos de prófugos de la justicia.

10 “Expertos a favor y en contra del reconocimiento facial, la nueva tecnología que llegó a la Ciudad” por Alejo Zagalsky para TN. Disponible en: https://tn.com.ar/tecno/f5/expertos-favor-y-en-contra-del-reconocimiento-facial-la-nueva-tecnologia-que-llego-la-ciudad_980840

11 “Seis días arrestado por un error del sistema de reconocimiento facial”, por Alejandra Hayon para Página|12. Publicada el 3 de agosto de 2019. Disponible en: https://www.pagina12.com.ar/209910-seis-dias-arrestado-por-un-error-del-sistema-de-reconocimien